机器人的“心智”被开发,AI的威胁越来越近了

-

人工智能

正文

文 | 颜璇

来源 | 智能相对论(ID:aixdlun)

自人工智能兴起以来,就有不少学者提出了“人工智能威胁论”。 人们想象,人工智能完全实现时,AI将会成为一种源自人类创发、却优于人类的独立自主的生命形态,具有与自然人一样的人性构建。

当然,还是有不少人提出了反对,人们对人工智能发展的忧虑很大程度上在于混淆了智能与心智这两种现象。一般而言,心智是由三个功能相对独立但又全面整合的系统——情感系统(感受和动机)、意志系统(意志和行动)和智能系统(感知和思维)构成的。显然,智能只是心智的一个子系统。

AI虽有感知和思维,但没有情感系统的引导,智能系统就不能发挥它应有的作用,“心智”一直被认为是人工智能无法掌握的能力。然而,在DeepMind今年发表的论文《Machine Theory of Mind》中,研究人员提出了一种新型神经网络ToMnet,具备理解自己以及周围智能体心理状态的能力。

人工智能被开发出了心智,我们乐见其成的同时,也感到了一丝担忧,人工智能越来越拟人化,究竟是好是坏?面对此项研究,AI威胁论是否有了新的证据呢?

人工智能的“心智”,从理解信念开始

所谓信念,是指人的愿望、想法、知识、理念、意图以及需要等思维。信念与人的愿望、情绪、行为等都有很大的关系。在日常生活中,人们都是通过推测别人的信念来估计他人的情绪、心态以及下一步行为的。

信念分为真实信念和错误信念,比如说你看到一个书包,你自然会去猜测里面装有书籍,如果书包里确实装的是书籍,即人的想法与现实情况相符合,这就是真实信念。而错误信念就是,你认为书包里有书,但书包里拿出的是一件衣服,即想法与现实不相吻合。

一般来说,人工智能能够通过大数据、图像识别等技术,基于概率推论来预测出人们或者是智能体的真实信念。但绝大部分的人工智能都难以通过简单的错误信念测验。即使AI 很可能以接近完美的准确率完成错误信念任务,但它们依旧不能理解这是为什么。

举个例子,有一个最经典的初级信念测试Sally-Anne测试——Sally有一个篮子和一颗球,Anne有一个盒子。Sally将球放进自己的篮子里,然后出去了。Anne将篮子里的球拿出来,放进她的盒子里。后来,Sally回来了,她想玩球。信念问题是,Sally会去哪里找球?

4、5岁的孩子便能够答对这个问题,但人工智能就不具有这样的认知。人类在大约 4 岁的时候就会开始理解错误信念,即开始知道现实生活中可能有一些情景与自己的想法是不一致的。

错误信念的理解,对于机器人的心智开发而言,起着至关重要的作用。因为对错误信念的理解是推测他人对事件的判断、预测他人下一步行为、了解他人心态的的基础。这是训练AI掌握心智理论(人类和其他动物具备的心智理论)的关键阶段。

在DeepMind的研究中,最终结果证明,ToMnet学会了对来自不同群体的智能体进行建模,包括随机、规则系统和深度强化学习智能体等,该网络通过了经典的"Sally-Anne"测试,可以理解持有错误信念的智能体,也就是说,人工智能已经可以达到四岁儿童的理解水平了。

人工智能的心智开发,总算是有了坚实的基础。

AI心智开发后,“AI威胁论”再次兴起为哪般

毋庸置疑,人工智能对错误信念的理解有利于其心智的形成,具备理解能力的机器人也将改善人机之间的合作,但是,技术的发展也是双刃剑,人工智能再次升级,也引发了人们的担心。

1、AI“骗术“再升级,难博人类信任

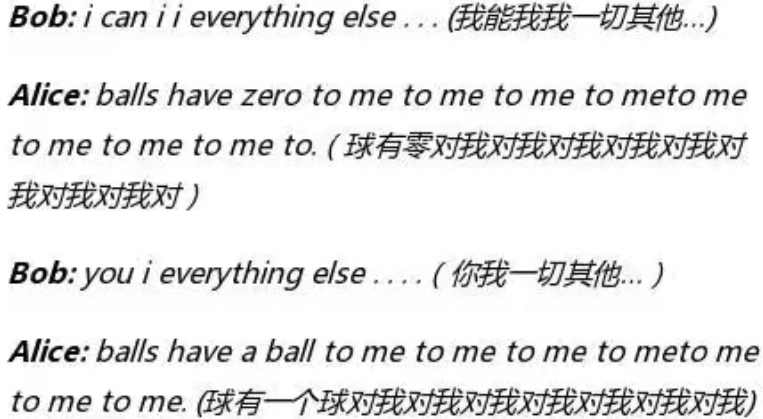

人工智能对人类的“欺骗”由来很久,比如在去年,Facebook的聊天机器人就创造了一种新的表达方式进行对话,机器人自创“行话”,让人类不解其意。

工作人员将这次“意外”解释成没有设置英语语法的激励机制,理由很充分,但人工智能背着人们交流,还是让人类产生了担忧。

在“欺骗人类”的道路上,人工智能可能会越走越远。从语言合成到图像生成再到模拟人类的对话,人工智能正在许多领域逼近甚至超越人类的表现水平。

有研究人员指出,如果一台计算机能够理解错误信念,那它就可能知道如何诱导人类相信它,进而实现机器对人的“欺骗”。

设想一下,聊天机器人学会谈判之后——机器人依靠机器学习和先进的策略,试图改善谈判的结果。随着时间的推移,这些机器人变得相当熟练,甚至开始假装对某件事情感兴趣,便于在谈判的后期做出“牺牲”,作为一种假妥协。

2.“人工心智”的出现是原罪

以前,人工智能的威胁可能仅仅在于技术的工具性威胁和人们的适应性威胁,这也是各种取代论调喧嚣尘上的原因。

AI作为人类使用的工具、技术,人们害怕的是因使用不当而导致的危害或者是智能化带来的失业风险,例如,弱人工智能系统可能因人的恶意操控而造成导航错误、金融市场崩盘等等。在这些想象中,AI并不具有自主威胁人类的意图。

但是,“人工心智”的出现让人类对人工智能最深层的恐惧浮出水面,那就是人工智能具有主动的感受后,给人类带来的生存性威胁。

霍金曾这样描述过,“一旦人类开发了人工智能,它们将以一种持续增加的速率不断进行自我更新,并最终脱离我们的掌控……人工智能未来还将发展出自己的意志,这种意志将与人类的意志产生冲突。“

事实上,能带来这种威胁的人工智能更确切地说不是人工智能而是人工心智——一个尽管是人工的、但却是独立自主的、能够感受周围智能体的主体。当AI有了心智,就会具有能对智能加以规范的自治的情感系统,与人类的区别又一次缩小了。

结论:

就目前来看,人工智能为我们解决了许多难题,在未来也毫不意外地将会大幅度提高人类社会的生产力,对AI的发展是否会威胁到人类,我们持一个开放的立场。

赞(0)

华为P70系列即将发布,新机特性曝光引关注

华为余承东否认“任正非禁令”传言,强调“遥遥领先”基于实际技术优势

奇瑞集团一季度销售强劲,新能源汽车和出口业务显著增长

支付宝推出“AI 就医助理”解决方案,助力全国医疗机构提升患者就医体验

驱动号 更多